1.本技术涉及语音处理技术领域,具体涉及一种语音合成方法、装置、电子设备及存储介质。

背景技术:

2.随着人工智能技术的发展,基于深度学习的研究在语音领域引起了广泛关注,在专业音频编辑、音乐创作、声音设计和电影后期制作(包括配音)等应用程序上取得了很大的成功。其中,一段语音包含以下信息:语言学内容(语音表述的内容)、说话人特征(如一个人的音色、音调等)和副语言特征(如情感等)。

3.目前在语音合成的研究中,现有技术只能够实现局部属性可控的语音合成,其所生成的语音仅仅是局部属性的改变。例如仅单一改变语音的内容特征,无法对说话人特征和情感特征进行可控的解耦。

技术实现要素:

4.由于现有方法存在上述问题,本技术实施例提供一种语音合成方法、装置、电子设备及存储介质。

5.具体的,本技术实施例提供了以下技术方案:

6.第一方面,本技术实施例提供了一种语音合成方法,包括:

7.获取待进行语音合成的目标语音;

8.将所述目标语音输入至语音合成模型中,得到合成语音;所述合成语音的语音属性由所述目标语音的语音属性组成;

9.其中,所述语音合成模型基于以下步骤进行训练,包括:

10.步骤1、获取具有相同语音属性的样本语音,并提取所述样本语音的语音特征,将所述语音特征输入至训练后的编码器中,得到语音特征向量;

11.步骤2、将所述语音特征向量输入至特征映射网络进行语音属性预划分,得到所述样本语音的各个语音属性对应的特征向量;

12.步骤3、将具有相同语音属性的特征向量进行交换,得到交换后的第一样本语音特征向量集合和第二样本语音特征向量集合;

13.步骤4、根据所述第一样本语音特征向量集合和所述第二样本语音特征向量集合,求解预设的语音属性交换损失函数,所述语音属性交换损失函数越小表示交换相同语音属性的特征向量后的语音与样本语音越接近;

14.步骤5、通过不断优化所述语音属性交换损失函数进行模型优化,当所述语音属性交换损失函数小于预设阈值时训练结束,从而获取训练好的语音合成模型。

15.可选的,训练所述编码器,包括:

16.根据输入所述编码器的语音特征和由解码器输出的合成语音,求解预设的编码器预训练损失函数,并基于所述编码器预训练损失函数对所述语音合成模型进行预训练。

17.可选的,所述特征映射网络由内容映射特征网络、说话人特征映射网络和情感特征映射网络组成;

18.相应的,将所述语音特征向量输入至特征映射网络进行语音属性预划分,得到所述样本语音的不同语音属性对应的特征向量,包括:

19.将所述语音特征向量输入至内容映射特征网络,得到所述样本语音的内容属性对应的内容特征向量,以及,将所述语音特征向量输入至说话人特征映射网络,得到所述样本语音的说话人属性对应的说话人特征向量,以及,将所述语音特征向量输入至情感特征映射网络,得到所述样本语音的情感属性对应的情感特征向量。

20.可选的,在得到所述样本语音的各个语音属性对应的特征向量后,还包括:

21.根据述样本语音的各个语音属性对应的特征向量进行语音重建,得到重建后的语音;

22.根据所述样本语音和所述重建后的语音,求解预设的属性预划分损失函数,所述属性预划分损失函数越小表示重建后的语音与原始样本语音越接近;

23.通过不断优化所述属性预划分损失函数进行所述特征映射网络的优化。

24.可选的,所述编码器预训练损失函数l

r

为:

25.l

r

=||d(e(x))

‑

x||

26.其中,d为编码器,e为解码器,x为样本语音。

27.可选的,所述属性预划分损失函数l

fr

为:

28.l

fr

=||d(c)

‑

x||+||d(c

(o)

)

‑

x

(o)

||

29.其中,x和x

(o)

为两个具有相同属性的样本语音,c和c

(o)

为样本语音x和x

(o)

经过编码器和特征映射网络后得到的特征向量。

30.可选的,所述语音属性交换损失函数l

sr

为:

[0031][0032]

其中,c

s

为具有相同属性语音的特征向量交换后得到的第一语音特征向量,为具有相同属性语音的特征向量交换后得到的第二语音特征向量。

[0033]

可选的,所述语音合成模型的总损失函数l(e,d;h,m)为:

[0034]

l(e,d;h,m)=l

r

+λ

fr

l

fr

+λ

fr

l

sr

[0035]

其中,l

r

为编码器预训练损失函数,l

fr

为属性预划分损失函数,l

sr

为语音属性交换损失函数,λ

fr

为引入的标量系数,用于控制损失项的相对重要性。

[0036]

第二方面,本技术实施例提供了一种语音合成装置,包括:

[0037]

获取模块,用于获取待进行语音合成的目标语音;

[0038]

处理模块,用于将所述目标语音输入至语音合成模型中,得到合成语音;所述合成语音的语音属性由所述目标语音的语音属性组成;

[0039]

其中,所述语音合成模型基于以下步骤进行训练,包括:

[0040]

步骤1、获取样本语音,并提取所述样本语音的语音特征,将所述语音特征输入训练后的编码器中,得到语音特征向量;

[0041]

步骤2、将所述语音特征向量输入至特征映射网络进行语音属性预划分,得到所述样本语音的各个语音属性对应的特征向量;

[0042]

步骤3、将具有相同语音属性的特征向量进行交换,得到交换后的第一样本语音特征向量集合和第二样本语音特征向量集合;

[0043]

步骤4、根据所述第一样本语音特征向量集合和所述第二样本语音特征向量集合,求解预设的语音属性交换损失函数,所述语音属性交换损失函数越小表示交换相同语音属性的特征向量后的语音与样本语音越接近;

[0044]

步骤5、通过不断优化所述语音属性交换损失函数进行模型优化,当所述语音属性交换损失函数小于预设阈值时训练结束,从而获取训练好的语音合成模型。

[0045]

第三方面,本发明实施例还提供了一种电子设备,包括存储器、处理器及存储在存储器上并可在处理器上运行的计算机程序,所述处理器执行所述计算机程序时实现如第一方面所述的语音合成方法。

[0046]

第四方面,本发明实施例还提供了一种非暂态计算机可读存储介质,其上存储有计算机程序,该计算机程序被处理器执行时实现如第一方面所述的语音合成方法。

[0047]

由上面技术方案可知,本技术实施例首先获取待进行语音合成的目标语音,然后将所述目标语音输入至语音合成模型中,得到合成语音;所述合成语音的语音属性由所述目标语音的语音属性组成,且不包含同一目标语音的两种语音属性;其中,所述语音合成模型基于以下步骤进行训练,包括:步骤1、获取样本语音,并提取所述样本语音的语音特征,将所述语音特征输入至训练后的编码器中,得到语音特征向量;步骤2、将所述语音特征向量输入至特征映射网络进行语音属性预划分,得到所述样本语音的各个语音属性对应的特征向量;步骤3、将具有相同语音属性的特征向量进行交换,得到交换后的第一样本语音特征向量集合和第二样本语音特征向量集合;步骤4、根据所述第一样本语音特征向量集合和所述第二样本语音特征向量集合,求解预设的语音属性交换损失函数,所述语音属性交换损失函数越小表示交换相同语音属性的特征向量后的语音与样本语音越接近;步骤5、通过不断优化所述语音属性交换损失函数进行模型优化,当所述语音属性交换损失函数小于预设阈值时训练结束,从而获取训练好的语音合成模型。由此可见,本技术实施例通过语音合成模型将多个目标语音的语音属性进行自由组合,生成新的语音,且新的语音不包含同一目标语音的两种语音属性,从而实现全局多属性可控的语音合成,而且保持全局语音信息一致。其中,在对语音合成模型进行训练的过程中,首先对编码器进行预训练,以使编码器具有提取语音特征的能力,然后利用特征映射网络对编码器提取到的语音耦合特征进行预划分,并通过将不同样本语音的相同属性特征进行交换来进一步训练模型,使得模型具有解耦相同语音属性的能力。本技术实施例通过精确控制每个语音属性信息的流动过程,实现全局多属性可控的语音合成,且容易实现,模型训练稳定并收敛快,对数据增强领域和影视领域带来深远的影响。

附图说明

[0048]

为了更清楚地说明本发明实施例或现有技术中的技术方案,下面将对实施例或现有技术描述中所需要使用的附图作简单地介绍,显而易见地,下面描述中的附图仅仅是本发明的一些实施例,对于本领域普通技术人员来讲,在不付出创造性劳动的前提下,还可以根据这些图获得其他的附图。

[0049]

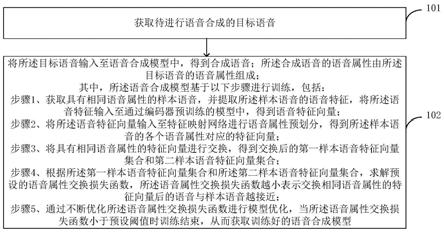

图1是本技术实施例提供的语音合成方法的步骤流程图之一;

[0050]

图2是本技术实施例提供的语音合成方法的步骤流程图之二;

[0051]

图3是本技术实施例提供的语音合成方法的步骤流程图之三;

[0052]

图4是本技术实施例提供的语音合成装置的模块示意图;

[0053]

图5是本技术实施例的电子设备的结构示意图。

具体实施方式

[0054]

为了更清楚地说明本技术实施例或现有技术中的技术方案,下面将对实施例或现有技术描述中所需要使用的附图作简单地介绍,显而易见地,下面描述中的附图仅仅是本发明的一些实施例,对于本领域普通技术人员来讲,在不付出创造性劳动的前提下,还可以根据这些图获得其他的附图。

[0055]

图1是本技术实施例提供的语音合成方法的步骤流程图之一,图2是本技术实施例提供的语音合成方法的步骤流程图之二,图3是本技术实施例提供的语音合成方法的步骤流程图之三。下面结合图1至图3对本技术实施例提供的语音合成方法进行详细解释和说明。

[0056]

如图1所示,本技术实施例提供的语音合成方法,包括:

[0057]

步骤101:获取待进行语音合成的目标语音;

[0058]

在本步骤中,可选的,获取3条待进行语音合成的目标语音,3条目标语音均包含3种语音属性,分别为语音内容、说话人和情感。

[0059]

步骤102:将所述目标语音输入至语音合成模型中,得到合成语音;所述合成语音的语音属性由所述目标语音的语音属性组成;

[0060]

其中,所述语音合成模型基于以下步骤进行训练,包括:

[0061]

步骤1、获取样本语音,并提取所述样本语音的语音特征,将所述语音特征输入至训练后的编码器中,得到语音特征向量;

[0062]

步骤2、将所述语音特征向量输入至特征映射网络进行语音属性预划分,得到所述样本语音的各个语音属性对应的特征向量;

[0063]

步骤3、将具有相同语音属性的特征向量进行交换,得到交换后的第一样本语音特征向量集合和第二样本语音特征向量集合;

[0064]

步骤4、根据所述第一样本语音特征向量集合和所述第二样本语音特征向量集合,求解预设的语音属性交换损失函数,所述语音属性交换损失函数越小表示交换相同语音属性的特征向量后的语音与样本语音越接近;

[0065]

步骤5、通过不断优化所述语音属性交换损失函数进行模型优化,当所述语音属性交换损失函数小于预设阈值时训练结束,从而获取训练好的语音合成模型。

[0066]

在本步骤中,需要说明的是,由于现有技术只能够实现局部属性可控的语音合成,因此,若要实现语音属性可控的解耦,需要精确控制每个语音属性信息的流动过程。因此,本技术实施例在训练语音合成模型的过程中,将样本语音之间的相同属性作为监督信息,通过特征映射网络进行语音属性信息交换和组合,以实现可控的解耦表征语音学习。其中,语音合成模型的训练过程具体为:首先获取一组样本语音,并基于主流方法提取样本语音的语音特征,然后将样本语音的语音特征输入至训练好的编码器中,可以得到样本语音的特征向量。在得到样本语音的特征向量后,将其输入至特征映射网络以进行语音属性的预

划分。其中,特征映射网络由内容特征映射网络、说话人特征映射网络和情感特征映射网络组成,分别用于生成不同语音属性对应的特征向量,例如:内容特征向量、说话人特征向量和情感特征向量。进一步的,将具有相同语音属性的特征向量进行交换,由于目的是交换相同属性后生成的语音与原语音相同,因此,在特征向量交换过程中,需要对内容、说话人和情感三个属性的特征向量均进行交换,以此来避免网络将所有信息存储到不被交换的区域。进一步的,在交换特征向量后,可以得到交换后的第一样本语音特征向量集合和第二样本语音特征向量集合,从而根据所述第一样本语音特征向量集合和所述第二样本语音特征向量集合,求解预设的语音属性交换损失函数,所述语音属性交换损失函数越小表示交换相同语音属性的特征向量后的语音与样本语音越接近。通过不断优化所述语音属性交换损失函数进行模型优化,当所述语音属性交换损失函数小于预设阈值时训练结束,从而获取训练好的语音合成模型。

[0067]

在本步骤中,当语音合成模型训练完成后,输入步骤101获取的3条目标语音,可以得到如图2所示的新和成的语音,其语音属性信息分别包括目标语音1的内容1、目标语音2的说话人2和目标语音3的情感3,从而实现全局多属性可控的语音合成。

[0068]

由上面技术方案可知,本技术实施例首先获取待进行语音合成的目标语音,然后将所述目标语音输入至语音合成模型中,得到合成语音;所述合成语音的语音属性由所述目标语音的语音属性组成,且不包含同一目标语音的两种语音属性;其中,所述语音合成模型基于以下步骤进行训练,包括:步骤1、获取具有相同语音属性的样本语音,并提取所述样本语音的语音特征,将所述语音特征输入至训练后的编码器中,得到语音特征向量;步骤2、将所述语音特征向量输入至特征映射网络进行语音属性预划分,得到所述样本语音的各个语音属性对应的特征向量;步骤3、将具有相同语音属性的特征向量进行交换,得到交换后的第一样本语音特征向量集合和第二样本语音特征向量集合;步骤4、根据所述第一样本语音特征向量集合和所述第二样本语音特征向量集合,求解预设的语音属性交换损失函数,所述语音属性交换损失函数越小表示交换相同语音属性的特征向量后的语音与样本语音越接近;步骤5、通过不断优化所述语音属性交换损失函数进行模型优化,当所述语音属性交换损失函数小于预设阈值时训练结束,从而获取训练好的语音合成模型。由此可见,本技术实施例通过语音合成模型将多个目标语音的语音属性进行自由组合,生成新的语音,且新的语音不包含同一目标语音的两种语音属性,从而实现全局多属性可控的语音合成,而且保持全局语音信息一致。其中,在对语音合成模型进行训练的过程中,首先对编码器进行预训练,以使编码器具有提取语音特征的能力,然后利用特征映射网络对编码器提取到的语音耦合特征进行预划分,并通过将不同样本语音的相同属性特征进行交换来进一步训练模型,使得模型具有解耦相同语音属性的能力。本技术实施例通过精确控制每个语音属性信息的流动过程,实现全局多属性可控的语音合成,而且保持了全局语音信息一致。本技术实施例容易实现,模型训练稳定并收敛快,对数据增强领域和影视领域带来深远的影响。

[0069]

基于上述实施例的内容,在本实施例中,训练所述编码器,包括:

[0070]

根据输入所述编码器的语音特征和由解码器输出的合成语音,求解预设的编码器预训练损失函数,并基于所述编码器预训练损失函数对编码器进行预训练。

[0071]

在本实施例中,需要说明的是,训练编码器的目的是让编码器具有提取语音特征的能力,将提取到的语音特征输入到编码器和解码器中,按照编码器的训练方式利用编码

器预训练损失函数对进行预训练。

[0072]

基于上述实施例的内容,在本实施例中,所述特征映射网络由内容映射特征网络、说话人特征映射网络和情感特征映射网络组成;

[0073]

相应的,将所述语音特征向量输入至特征映射网络进行语音属性预划分,得到所述样本语音的不同语音属性对应的特征向量,包括:

[0074]

将所述语音特征向量输入至内容映射特征网络,得到所述样本语音的内容属性对应的内容特征向量,以及,将所述语音特征向量输入至说话人特征映射网络,得到所述样本语音的说话人属性对应的说话人特征向量,以及,将所述语音特征向量输入至情感特征映射网络,得到所述样本语音的情感属性对应的情感特征向量。

[0075]

基于上述实施例的内容,在本实施例中,在得到所述样本语音的各个语音属性对应的特征向量后,还包括:

[0076]

根据述样本语音的各个语音属性对应的特征向量进行语音重建,得到重建后的语音;

[0077]

根据所述样本语音和所述重建后的语音,求解预设的属性预划分损失函数,所述属性预划分损失函数越小表示重建后的语音与原始样本语音越接近;

[0078]

通过不断优化所述属性预划分损失函数进行所述特征映射网络的优化。

[0079]

在本实施例中,需要说明的是,在进行语音属性预划分后,为了使特征映射网络没有在属性划分时改变或损失语音信息,利用解码器重建回原语音。

[0080]

基于上述实施例的内容,在本实施例中,所述属性预划分损失函数l

fr

为:

[0081]

l

fr

=||d(c)

‑

x||+||d(c

(o)

)

‑

x

(o)

||

[0082]

其中,x和x

(o)

为两个具有相同属性的样本语音,c和c

(o)

为样本语音x和x

(o)

经过编码器和特征映射网络后得到的特征向量。

[0083]

基于上述实施例的内容,在本实施例中,所述语音属性交换损失函数l

sr

为:

[0084][0085]

其中,c

s

为具有相同属性语音的特征向量交换后得到的第一语音特征向量,为具有相同属性语音的特征向量交换后得到的第二语音特征向量。

[0086]

基于上述实施例的内容,在本实施例中,所述语音合成模型的总损失函数l(e,d;h,m)为:

[0087]

l(e,d;h,m)=l

r

+λ

fr

l

fr

+λ

fr

l

sr

[0088]

其中,l

r

为编码器预训练损失函数,l

fr

为属性预划分损失函数,l

sr

为语音属性交换损失函数,λ

fr

为引入的标量系数,用于控制损失项的相对重要性。

[0089]

下面通过具体实施例进行说明:

[0090]

实施例一:

[0091]

在本实施例中,如图3所示,训练语音合成模型分为两个阶段,第一阶段通过自编码器训练网络,让编码器具有提取语音特征的能力,用重建损失进行约束,此时经过编码器提取到的特征是耦和的,通过第二阶段进行解耦操作;第二阶段让编码器和特征映射模块具有可控的解耦表征学习能力,首先利用特征映射模块对编码器提取到的耦和特征进行预划分,将与划分后的特征利用重建损失进行约束,并重建回原语音。其次同时对语音的相同

属性进行交换后并重建,如果属性交换后的语音可以成功重建回原语音,则模型具有解耦相同属性的能力,通过特征交换模块实现这一功能。

[0092]

在本实施例中,进行编码器预训练的目的是让编码器具提取语音特征的能力,包括特征提取模块、编码器(e)和解码器(d)。首先将每条语音x输入到特征提取模块,提取到语音mfcc、基频和共振峰特征。其中,mfcc特征提取方法为:

[0093][0094]

其中,语音x对于n时刻语音的采样值为x[n],加窗后的采样点个数是n。基频特征通过主流方法来提取,网络包含6个卷积层和一个全连接层,通过lpc方法提取共振峰特征。

[0095]

在本实施例中,将提取到的语音特征输入到e和d中,按照自编码器的训练方式用重建损失训练网络。

[0096]

在本实施例中,对经过编码器提取到的特征进行预划分。由三个神经网络组成,包括内容特征映射网络,说话人特征映射网络和情感特征映射网络。语音经过编码器得到它的特征向量,然后经过特征映射模块,生成不同属性对应的特征向量,如内容特征向量、说话人特征向量、情感特征向量。

[0097]

在本实施例中,设计相同属性特征交换模块。将两条具有相同属性的语音交换相同属性后并重建回原语音,可以使模型具有解耦相同属性的能力。交换(swap)公式:两个特征向量(例如c1和c2)交换一个属性(例如,2)

[0098][0099][0100]

在本实施例中,首先将具有相同属性的语音分别通过特征提取模块和e得到它们的特征向量,其次将特征向量输入到特征映射模块进行特征预划分,得到属性预划分好的特征向量。因为希望特征映射模块没有改变或损失语音信息,因此用d重建回原语音。

[0101]

在本实施例中,当加入特征映射模块后的自编器训练完成后,经过e和特征映射模块生成的特征向量为c,c

(o)

,通过相同属性特征交换模块对c,c

(o)

中相同属性的预划分区域进行交换,属性交换完成后得到两个新的特征向量c

s

,最后通过d生成两条新的语音。由于希望交换相同属性后生成的语音应该与原语音相同。在交换过程中,需要对内容、说话人和情感的三个属性都要交换,以此来避免网络将所有信息存储到不被交换的区域。这一阶段通过交换实现了可控的解耦表征学习。

[0102]

在本实施例中,当语音合成模型训练完成后输入三条语音,经过编码器和特征映射模块对语音特征进行解耦,对解耦后的内容、说话人、和情感三个属性随机组合,通过解码器生成新的语音。本技术实施例容易实现,训练稳定并收敛快,对数据增强领域和影视领域带来深远的影响。

[0103]

基于相同的发明构思,本发明另一实施例提供了一种语音合成装置,如图4所示,所述装置包括:

[0104]

获取模块1,用于获取待进行语音合成的目标语音;

[0105]

处理模块2,用于将所述目标语音输入至语音合成模型中,得到合成语音;所述合成语音的语音属性由所述目标语音的语音属性组成;

[0106]

其中,所述语音合成模型基于以下步骤进行训练,包括:

[0107]

获取样本语音,并提取所述样本语音的语音特征,将所述语音特征输入训练后的编码器中,得到语音特征向量;

[0108]

将所述语音特征向量输入至特征映射网络进行语音属性预划分,得到所述样本语音的各个语音属性对应的特征向量;

[0109]

将具有相同语音属性的特征向量进行交换,得到交换后的第一样本语音特征向量集合和第二样本语音特征向量集合;

[0110]

根据所述第一样本语音特征向量集合和所述第二样本语音特征向量集合,求解预设的语音属性交换损失函数,所述语音属性交换损失函数越小表示交换相同语音属性的特征向量后的语音与样本语音越接近;

[0111]

通过不断优化所述语音属性交换损失函数进行模型优化,当所述语音属性交换损失函数小于预设阈值时训练结束,从而获取训练好的语音合成模型。

[0112]

在本实施例中,可选的,获取3条待进行语音合成的目标语音,3条目标语音均包含3种语音属性,分别为语音内容、说话人和情感。

[0113]

在本实施例中,需要说明的是,由于现有技术只能够实现局部属性可控的语音合成,因此,若要实现语音属性可控的解耦,需要精确控制每个语音属性信息的流动过程。因此,本技术实施例在训练语音合成模型的过程中,将样本语音之间的相同属性作为监督信息,通过特征映射网络进行语音属性信息交换和组合,以实现可控的解耦表征语音学习。其中,语音合成模型的训练过程具体为:首先获取一组样本语音,并基于主流方法提取样本语音的语音特征,然后将样本语音的语音特征输入至训练好的编码器中,可以得到样本语音的特征向量。在得到样本语音的特征向量后,将其输入至特征映射网络以进行语音属性的预划分。其中,特征映射网络由内容特征映射网络、说话人特征映射网络和情感特征映射网络组成,分别用于生成不同语音属性对应的特征向量,例如:内容特征向量、说话人特征向量和情感特征向量。进一步的,将具有相同语音属性的特征向量进行交换,由于目的是交换相同属性后生成的语音与原语音相同,因此,在特征向量交换过程中,需要对内容、说话人和情感三个属性的特征向量均进行交换,以此来避免网络将所有信息存储到不被交换的区域。进一步的,在交换特征向量后,可以得到交换后的第一样本语音特征向量集合和第二样本语音特征向量集合,从而根据所述第一样本语音特征向量集合和所述第二样本语音特征向量集合,求解预设的语音属性交换损失函数,所述语音属性交换损失函数越小表示交换相同语音属性的特征向量后的语音与样本语音越接近。通过不断优化所述语音属性交换损失函数进行模型优化,当所述语音属性交换损失函数小于预设阈值时训练结束,从而获取训练好的语音合成模型。

[0114]

在本实施例中,当语音合成模型训练完成后,输入获取的3条目标语音,可以得到如图2所示的新和成的语音,其语音属性信息分别包括目标语音1的内容1、目标语音2的说话人2和目标语音3的情感3,从而实现全局多属性可控的语音合成。

[0115]

由上面技术方案可知,本技术实施例首先获取待进行语音合成的目标语音,然后

将所述目标语音输入至语音合成模型中,得到合成语音;所述合成语音的语音属性由所述目标语音的语音属性组成,且不包含同一目标语音的两种语音属性;其中,所述语音合成模型基于以下步骤进行训练,包括:步骤1、获取样本语音,并提取所述样本语音的语音特征,将所述语音特征输入至训练后的编码器中,得到语音特征向量;步骤2、将所述语音特征向量输入至特征映射网络进行语音属性预划分,得到所述样本语音的各个语音属性对应的特征向量;步骤3、将具有相同语音属性的特征向量进行交换,得到交换后的第一样本语音特征向量集合和第二样本语音特征向量集合;步骤4、根据所述第一样本语音特征向量集合和所述第二样本语音特征向量集合,求解预设的语音属性交换损失函数,所述语音属性交换损失函数越小表示交换相同语音属性的特征向量后的语音与样本语音越接近;步骤5、通过不断优化所述语音属性交换损失函数进行模型优化,当所述语音属性交换损失函数小于预设阈值时训练结束,从而获取训练好的语音合成模型。由此可见,本技术实施例通过语音合成模型将多个目标语音的语音属性进行自由组合,生成新的语音,且新的语音不包含同一目标语音的两种语音属性,从而实现全局多属性可控的语音合成,而且保持全局语音信息一致。其中,在对语音合成模型进行训练的过程中,首先对编码器进行预训练,以使编码器具有提取语音特征的能力,然后利用特征映射网络对编码器提取到的语音耦合特征进行预划分,并通过将不同样本语音的相同属性特征进行交换来进一步训练模型,使得模型具有解耦相同语音属性的能力。本技术实施例通过精确控制每个语音属性信息的流动过程,实现全局多属性可控的语音合成,而且保持了全局语音信息一致。本技术实施例容易实现,模型训练稳定并收敛快,对数据增强领域和影视领域带来深远的影响。

[0116]

基于相同的发明构思,本发明又一实施例提供了一种电子设备,参见图5所述电子设备的结构示意图,具体包括如下内容:处理器501、存储器502、通信接口503和通信总线504;

[0117]

其中,所述处理器501、存储器502、通信接口503通过所述通信总线504完成相互间的通信;所述通信接口503用于实现各设备之间的信息传输;

[0118]

所述处理器501用于调用所述存储器502中的计算机程序,所述处理器执行所述计算机程序时实现上述一种语音合成方法的全部步骤,例如,获取待进行语音合成的目标语音;将所述目标语音输入至语音合成模型中,得到合成语音;所述合成语音的语音属性由所述目标语音的语音属性组成,且不包含同一目标语音的两种语音属性;其中,所述语音合成模型基于以下步骤进行训练,包括:步骤1、获取样本语音,并提取所述样本语音的语音特征,将所述语音特征输入至训练后的编码器中,得到语音特征向量;步骤2、将所述语音特征向量输入至特征映射网络进行语音属性预划分,得到所述样本语音的各个语音属性对应的特征向量;步骤3、将具有相同语音属性的特征向量进行交换,得到交换后的第一样本语音特征向量集合和第二样本语音特征向量集合;步骤4、根据所述第一样本语音特征向量集合和所述第二样本语音特征向量集合,求解预设的语音属性交换损失函数,所述语音属性交换损失函数越小表示交换相同语音属性的特征向量后的语音与样本语音越接近;步骤5、通过不断优化所述语音属性交换损失函数进行模型优化,当所述语音属性交换损失函数小于预设阈值时训练结束,从而获取训练好的语音合成模型。

[0119]

基于相同的发明构思,本发明又一实施例提供了一种非暂态计算机可读存储介质,该计算机可读存储介质上存储有计算机程序,该计算机程序被处理器执行时实现上述

一种语音合成方法的全部步骤,例如,获取待进行语音合成的目标语音;将所述目标语音输入至语音合成模型中,得到合成语音;所述合成语音的语音属性由所述目标语音的语音属性组成,且不包含同一目标语音的两种语音属性;其中,所述语音合成模型基于以下步骤进行训练,包括:步骤1、获取样本语音,并提取所述样本语音的语音特征,将所述语音特征输入至训练后的编码器中,得到语音特征向量;步骤2、将所述语音特征向量输入至特征映射网络进行语音属性预划分,得到所述样本语音的各个语音属性对应的特征向量;步骤3、将具有相同语音属性的特征向量进行交换,得到交换后的第一样本语音特征向量集合和第二样本语音特征向量集合;步骤4、根据所述第一样本语音特征向量集合和所述第二样本语音特征向量集合,求解预设的语音属性交换损失函数,所述语音属性交换损失函数越小表示交换相同语音属性的特征向量后的语音与样本语音越接近;步骤5、通过不断优化所述语音属性交换损失函数进行模型优化,当所述语音属性交换损失函数小于预设阈值时训练结束,从而获取训练好的语音合成模型。

[0120]

此外,上述的存储器中的逻辑指令可以通过软件功能单元的形式实现并作为独立的产品销售或使用时,可以存储在一个计算机可读取存储介质中。基于这样的理解,本发明的技术方案本质上或者说对现有技术做出贡献的部分或者该技术方案的部分可以以软件产品的形式体现出来,该计算机软件产品存储在一个存储介质中,包括若干指令用以使得一台计算机设备(可以是个人计算机,服务器,或者网络设备等)执行本发明各个实施例所述方法的全部或部分步骤。而前述的存储介质包括:u盘、移动硬盘、只读存储器(rom,read

‑

only memory)、随机存取存储器(ram,random access memory)、磁碟或者光盘等各种可以存储程序代码的介质。

[0121]

以上所描述的装置实施例仅仅是示意性的,其中所述作为分离部件说明的单元可以是或者也可以不是物理上分开的,作为单元显示的部件可以是或者也可以不是物理单元,即可以位于一个地方,或者也可以分布到多个网络单元上。可以根据实际的需要选择其中的部分或者全部模块来实现本发明实施例方案的目的。本领域普通技术人员在不付出创造性的劳动的情况下,即可以理解并实施。

[0122]

通过以上的实施方式的描述,本领域的技术人员可以清楚地了解到各实施方式可借助软件加必需的通用硬件平台的方式来实现,当然也可以通过硬件。基于这样的理解,上述技术方案本质上或者说对现有技术做出贡献的部分可以以软件产品的形式体现出来,该计算机软件产品可以存储在计算机可读存储介质中,如rom/ram、磁碟、光盘等,包括若干指令用以使得一台计算机设备(可以是个人计算机,服务器,或者网络设备等)执行各个实施例或者实施例的某些部分所述的语音合成方法。

[0123]

最后应说明的是:以上实施例仅用以说明本发明的技术方案,而非对其限制;尽管参照前述实施例对本发明进行了详细的说明,本领域的普通技术人员应当理解:其依然可以对前述各实施例所记载的技术方案进行修改,或者对其中部分技术特征进行等同替换;而这些修改或者替换,并不使相应技术方案的本质脱离本发明各实施例技术方案的精神和范围。